人脸匿名化论文笔记(2023.1)

Live

Face De-Identification in Video

视频中的活体人脸去身份化

2019.10 Oran Gafni等 Facebook

针对问题

视频需要以无缝的方式进行修改,不引起闪烁或其他视觉伪影和失真,从而使得只让 身份 发生改变,而所有 其他因素 保持不变。这里的其他因素包括 姿势、表情、遮挡、光照和阴影及其动态变化。

在此法中,身份的移除不是通过 解耦 而是通过 感知损失 来完成的。解耦的效果 可能会比较脆弱,并且对超参数敏感。

所提方法

我们的架构基于对抗自编码器,再加上一个训练好的人脸分类器。

通过将自编码器的潜空间与人脸分类器表示层级联,我们实现了同时嵌入了身份和表情信息的潜空间。生成任务具有高度语义性,其损失不能是常规的重建损失。

为了对目标图像进行编码,我们使用预训练的人脸分类器ResNet - 50网络,在VGGFace2数据集上进行训练。

测试期间的处理与换脸文献中采取的步骤类似,涉及以下步骤:

( a )使用" dlib " 人脸检测器提取一个正方形边界框。

( b )检测68个面部点。

( c )提取变换矩阵,使用估计的相似变换(尺度、旋转和平移)到平均的人脸。

( d )将估计变换应用于输入人脸。

( e )将变换后的人脸与目标图像的表示一起传递给我们的网络,得到输出图像和掩膜。

( f )利用相似变换的逆,将输出图像和掩膜进行反投影。

( g )根据变换掩模的权重,将输入和网络的变换输出图像按像素线性混合生成输出帧。

( h )在面部点凸包定义的区域内,将结果合并到原始帧中。

训练步骤如下:

( a )对人脸图像进行失真和增强。这是通过施加随机缩放、旋转和弹性变形来实现的。

( b )将失真图像与目标图像的表示一起输入网络。在训练时,我们选择相同的不失真的图像。

( c )将上面的掩膜输出(步骤( g ) )和未失真的输入线性组合送入判别器。

( d )在网络的掩膜和图像输出以及掩码输出上施加损失。

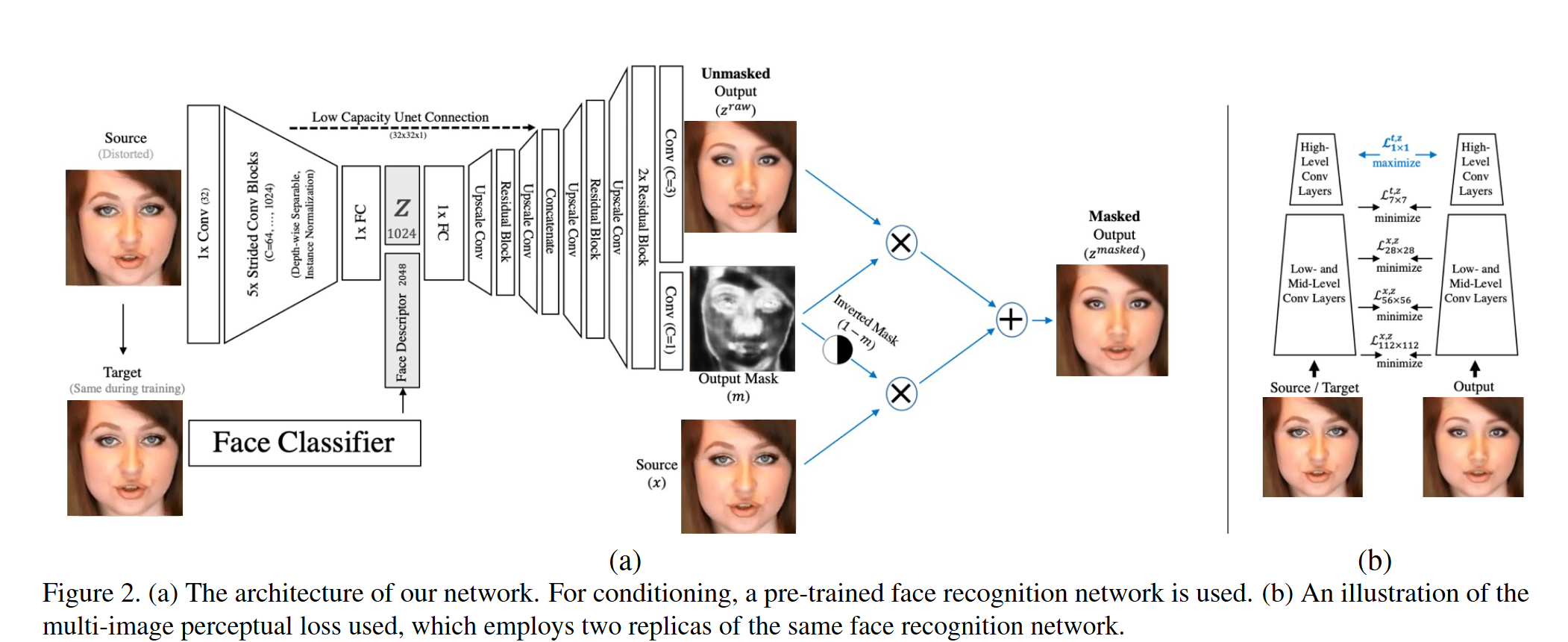

- 网络结构

编码器由一个卷积层组成,后面是五个跨步的、深度可分的卷积。随后,采用单个全连接层,串联目标人脸。解码器由一个全连接层组成,后面是上采样层和残差块,最后对输出图像使用tanh激活函数卷积,对掩膜输出使用sigmoid激活函数卷积。

采用U - net连接( 32x32x1 ),从而缓解了自编码器的瓶颈,使得更专注于与转移相关的信息编码。连接大小不超过瓶颈尺寸( 1024 ),并且由于输入图像的失真,避免了在训练早期崩溃。

判别器由4个带LReLU激活的跨步卷积组成,除第1个跨步卷积外,所有跨步卷积都进行了归一化。sigmoid激活卷积产生单个输出。

- 损失函数

对于除了判别器D之外所有网络的训练,我们使用一个复合损失

- 多图像的感知损失

如图2所示,多图像感知损失的目的是最小化推理过程中的模拟误差项(泛化误差)。保持源表情、姿势和光照条件,同时捕捉目标身份本质。通过使用(+)几个中低抽象层上使用未失真的 源图 和 生成的输出图 之间的感知损失,同时 疏远(-) 目标和 生成输出 之间的 高抽象层感知损失 来实现的。

结论

其贡献是提出一种适用于视频(包括实时视频)的人脸匿名化方法,采用了连接到嵌入空间的现有面部描述符、用于混合的已学习掩膜、用于获得所需效果的新型感知损失。最小程度的改变图像 是用 低级和中级特征来衡量的。

Password-conditioned

Anonymization and Deanonymization with Face Identity

Transformers

使用面部身份转换器的密码条件匿名化和去匿名化

2020 Xiuye Gu等 Stanford

针对问题

隐私和可访问性之间的矛盾。一方面,我们想要一个可以匿名化敏感区域(面部身份)的系统,这样即使黑客获得了对此类数据的访问权限,他们也无法知道此人的身份。另一方面,可视化数据的所有者本能地希望看到原始数据,而不是匿名数据。

内存消耗尽量小

照片逼真度要高

与背景的兼容性好

使用密码进行匿名化

使用反向密码进行去匿名化。只有提供正确的密码才能恢复原来的身份。

使用错误的反向密码进行错误的去匿名化。

多样性。使用不同的密码产生不同的身份。

使用方法

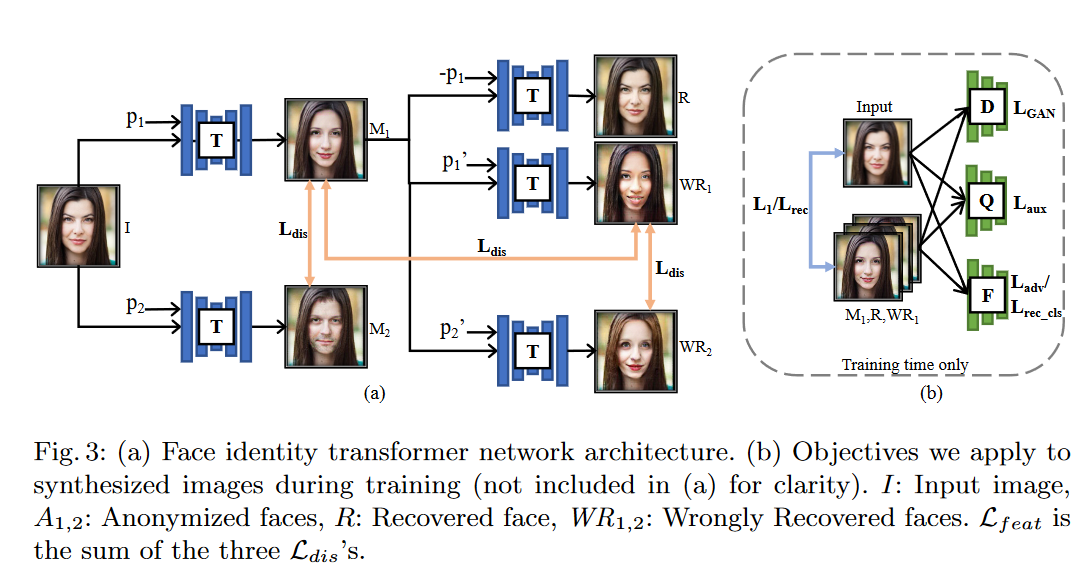

人脸识别变换器

- 密码方案

密码格式:

- 多模态身份变换

因此,为了引起不同的高级身份变化,我们提出了特征差异损失。具体来说,我们使用人脸识别模型

定义损失有三个部分:(1) 两张密码不同的匿名脸,(2) 两张错误密码不同的去匿名化后的脸,(3) 匿名脸和错误恢复的脸 之间的损失。

- 多任务学习目标

目的:进一步提升身份改变、身份恢复和照片真实感的效果。

采用3个正则项:重建损失、背景保留损失、照片真实感损失。

结论

提出了一种具有密码嵌入、多模态身份变换和多任务学习目标的新型隐私保护人脸身份转换器。有时出现与一般 GAN 失真相似的失真现象。

Personalized

and Invertible Face De-identification by Disentangled Identity

Information

Manipulation

通过分离身份信息操作进行个性化且可逆的人脸匿名化

2021.10 Jingyi Cao等 上交

针对问题

避免面部表情、行为等非敏感信息的恶化,

根据应用控制隐私保护程度,

能够在安全的情况下恢复原始图像。

问题描述

输入:源人脸图像

匿名化(去识别):为了达到身份保护的有效性,我们的目标是被保护的图像将具有与原始图像不同的身份信息,可以表述为,

多样性:我们可以设置不同的密码

可控性:我们可以通过可调参数

可恢复性:如果用户将去标识化结果

提出方法

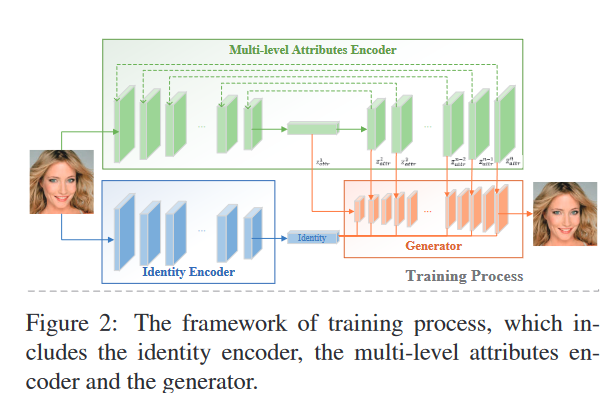

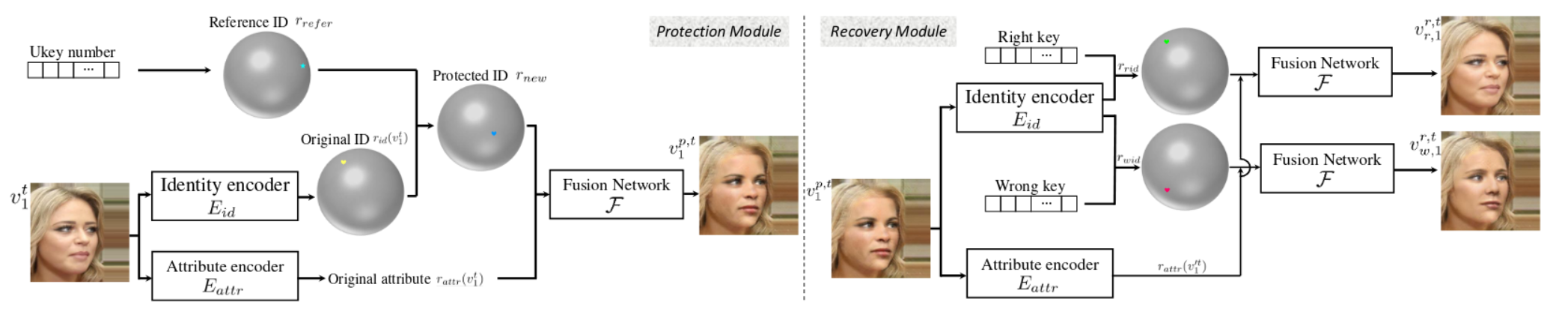

训练过程的网络框架如下图所示。

网络结构

身份编码器:使用预训练的人脸识别模型作为身份编码器

属性编码器:为了更好地保留表情、姿势、光照等属性的细节,我们采用了类似 U-Net 的结构,并将属性表示表示为多级特征图。

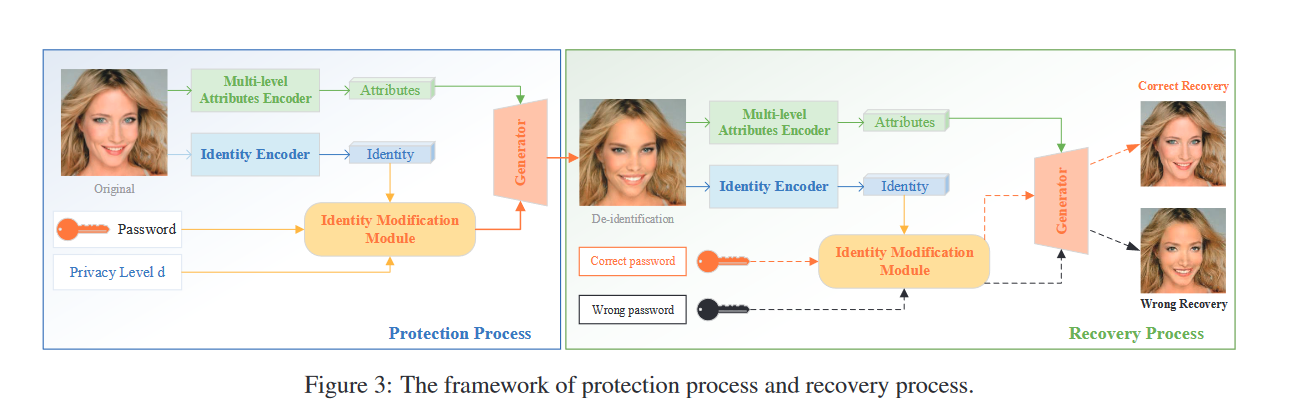

身份修改模块:身份修改模块主要编辑具有潜在空间操作的身份嵌入。在保护过程中,我们首先从预定义的参考身份向量库中提取一个参考向量

生成器:生成器需要基于

训练过程

在训练过程中,身份编码器

损失函数:身份一致性损失

保护过程

生成特定的匿名化图像,其身份得到保护,而其他属性保持不变。

恢复过程

只有在提供正确的密码和隐私级别时才能将去匿名化图像

结论

在本文中,我们提出了一种用于隐私保护的个性化和可逆匿名化方法。我们的方法首先 解开 身份和属性 的表示,基于密码和隐私级别参数使用 潜在空间操作加密或恢复身份,最后重建或恢复图像。在保护阶段,我们的方法可以使用 不同的密码 生成个性化的去标识化结果,并通过隐私级别参数控制与原始身份的距离。在恢复阶段,当且仅当给出相应的密码时,我们的方法才能恢复,而当攻击者尝试输入错误的密码时,将生成具有另一个身份的图像。

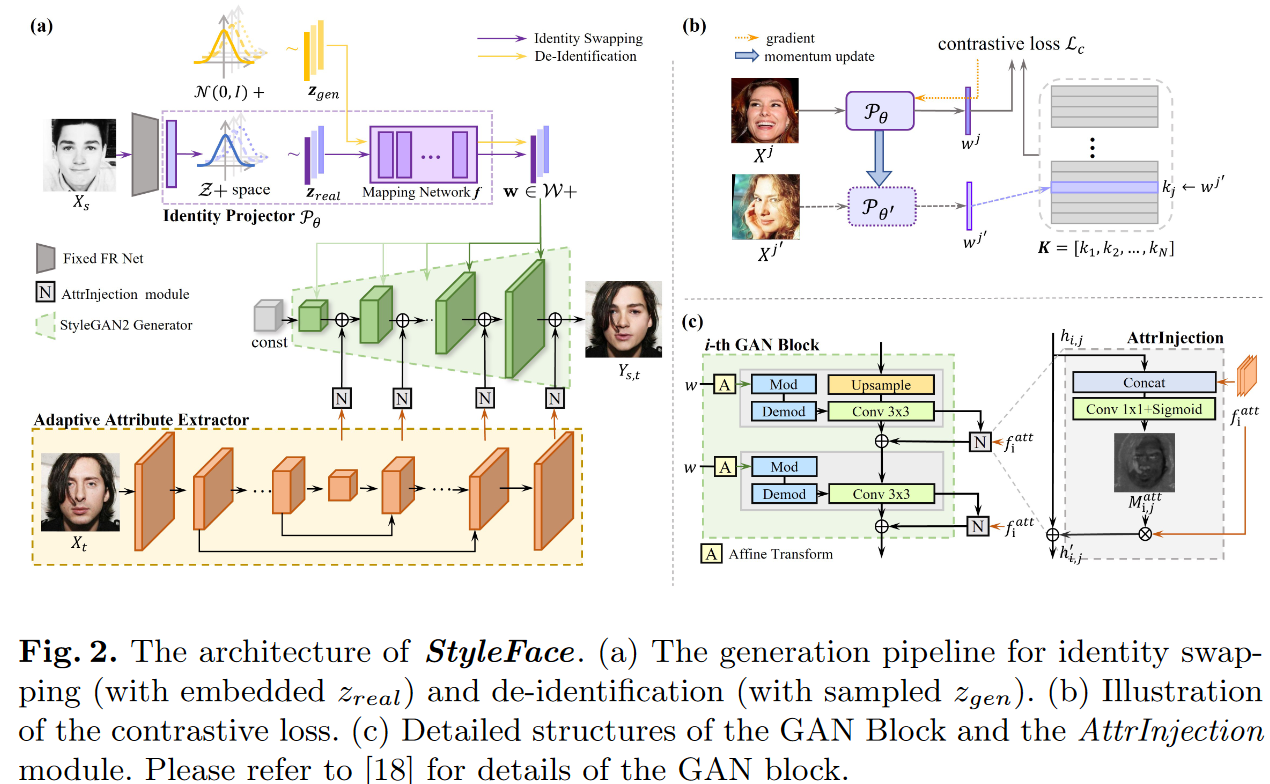

StyleFace:

Towards Identity-Disentangled Face Generation on

Megapixels

StyleFace:面向百万像素上身份分离的人脸生成

2022 Yuchen Luo等 上交&腾讯

针对问题

先前的方法往往存在 匿名化多样性差 和 缺乏对属性保留的监督,导致视觉效果不够真实。

将 身份交换 和 匿名化 两个任务统一到一个框架中,通过 身份交换 方案中的监督信号来提升匿名化的性能。

在 百万像素 上生成高保真身份分离人脸仍然是一个未解决的问题。

提出方法

使用身份交换方案训练 StyleFace:

给定源图像

训练完成后,就可以通过直接采样虚拟身份来匿名化图像

利用 StyleGAN2 模型生成高分辨率图像,其中身份作为style,属性作为噪声输入。

为了构建潜在身份空间并提高生成保真度,设计了身份投影和自适应属性提取器 (AAE)。

身份投影

为了在一个框架中统一身份交换和匿名化,我们希望将身份表示为一个潜在变量,以嵌入真实身份并生成虚拟身份。此法设计了一种基于变分自动编码器 (VAE) 的投影器,以将身份先验从预训练的人脸识别 (FR) 网络投影到 StyleGAN2 模型的潜在空间。

这里不像典型的 VAE 那样添加额外的重建任务,而是使用身份保持目标函数来保证有效身份信息不丢失。

为了将身份嵌入到

空间是一个复杂的非高斯分布,对均匀性没有约束。 训练数据集中不同 ID 的数量是有限的,因此

可能不会跨越整个 空间,而只能跨越一个小的子空间。因此,我们尝试通过对比学习来解决这个问题。

对比学习。 对比损失优化了positive

pair特征的对齐和诱导分布的均匀性。为了从随机采样的潜编码中生成合理的身份,

中间身份表示

相同身份样本的

编码 聚集在一起。 所有的

编码 均匀分布在 空间中。为此,我们引入了对 的对比约束。

我们将嵌入图像

如图2所示,我们创建了另一个编码器

我们通过

中间表示受对比损失

自适应属性提取器

多级属性编码。 设计了一个轻量级的 U 形 DNN

来提取各种分辨率的特征,使第

自适应属性分解。

提取的多级特征包含冗余信息,例如目标图像的身份信息,而我们希望只保留目标属性的最少信息。因此,我们为相应的

AttrInjection 模块预测控制掩膜

如图 2 (c) 所示,我们在不修改 GAN 结构的情况下将蒸馏后的属性信息合并到生成过程中。

既保持了目标图像中的多层次信息和空间对应关系,又过滤掉了冗余信息。

损失函数

属性保留损失

身份保持损失

及GAN损失

结论

本文提出了一种新颖的框架 StyleFace,它将 身份交换 和 匿名化统一在一个模型中,并实现了百万像素的高保真人脸渲染。为了弥合身份交换和去识别化之间的差距,我们将身份先验嵌入到潜空间中,并引入对比约束以进一步正则化。我们利用 StyleGAN2 进行百万像素级生成,并设计了一个 自适应属性提取器 来保留与身份无关的信息。我们表明,所提出的模型可以生成具有嵌入式真实身份和采样虚拟身份的高保真结果。

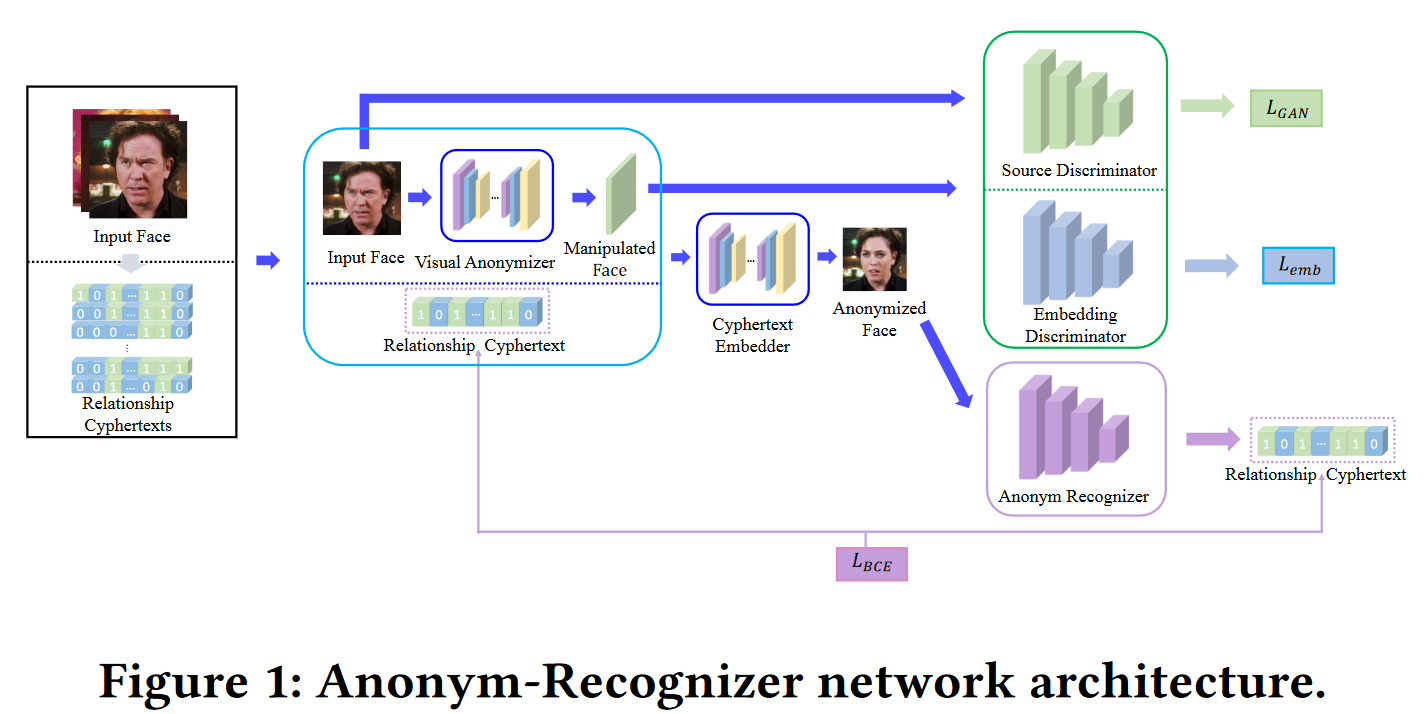

Anonym-Recognizer:

Relationship-preserving Face Anonymization and

Recognition

Anonym-Recognizer: 保持关系的人脸匿名化和识别

2022 Chunlei Peng 西电

针对问题

采用现有的人脸匿名化技术匿名化后的人脸无法再用于人脸识别。

具体的,本文motivation:

生成 除非使用我们的框架 否则无法提取其真实身份 的匿名化人脸。

提出方法

人脸匿名化

关系密文生成。 人脸图像之间的身份关系 被编码为二进制关系密文,可以是任意二进制ID。

密文需要满足以下2个条件:

不同人的人脸图像应该有不同的密文;

来自同一个人的面部图像应保持其密文相同。

关系密文可以通过 MD5 或 SHA-256

加密算法生成,其中人脸的身份、姓名、性别等隐私信息被加密。在本文中,关系密文的维度

框架流程。

匿名化流程如上图所示,我们希望 Visual Anonymizer

改变输入图像的身份并生成高质量图像。Visual Anonymizer输入人脸图像

为了指导上层身份变化,我们使用预训练的人脸识别网络 Embedding Discriminator 来 提取深度嵌入特征 并 最小化输入图像和匿名图像之间的余弦相似度。

为了 保留背景信息,引入损失函数

训练 Cyphertext Embedder 和 Anonym Recognizer:将关系密文

为了 使 Anonym Recognizer

能够准确提取匿名人脸图像中嵌入的密文,引入

为了 减少嵌入密文对人脸图像视觉质量(外观上)的影响,引入

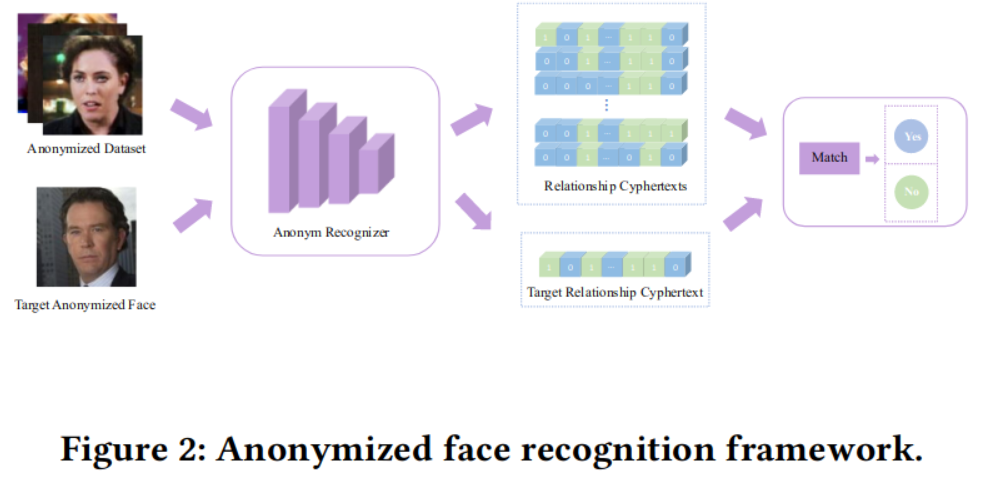

匿名化人脸识别

如上图所示,我们将 目标图像的关系密文 与 数据集的每个关系密文进行比较, 将 L1 距离最小的图像 作为 匹配结果。

结论

提出了一种保持关系的人脸匿名化识别方法Anonym-Recognizer。 该方法通过引入 关系密文 并将它们嵌入到匿名图像中来 完成匿名人脸的识别任务。Anonym-Recognizer 可以从匿名人脸中提取密文,在匿名环境中进行识别。

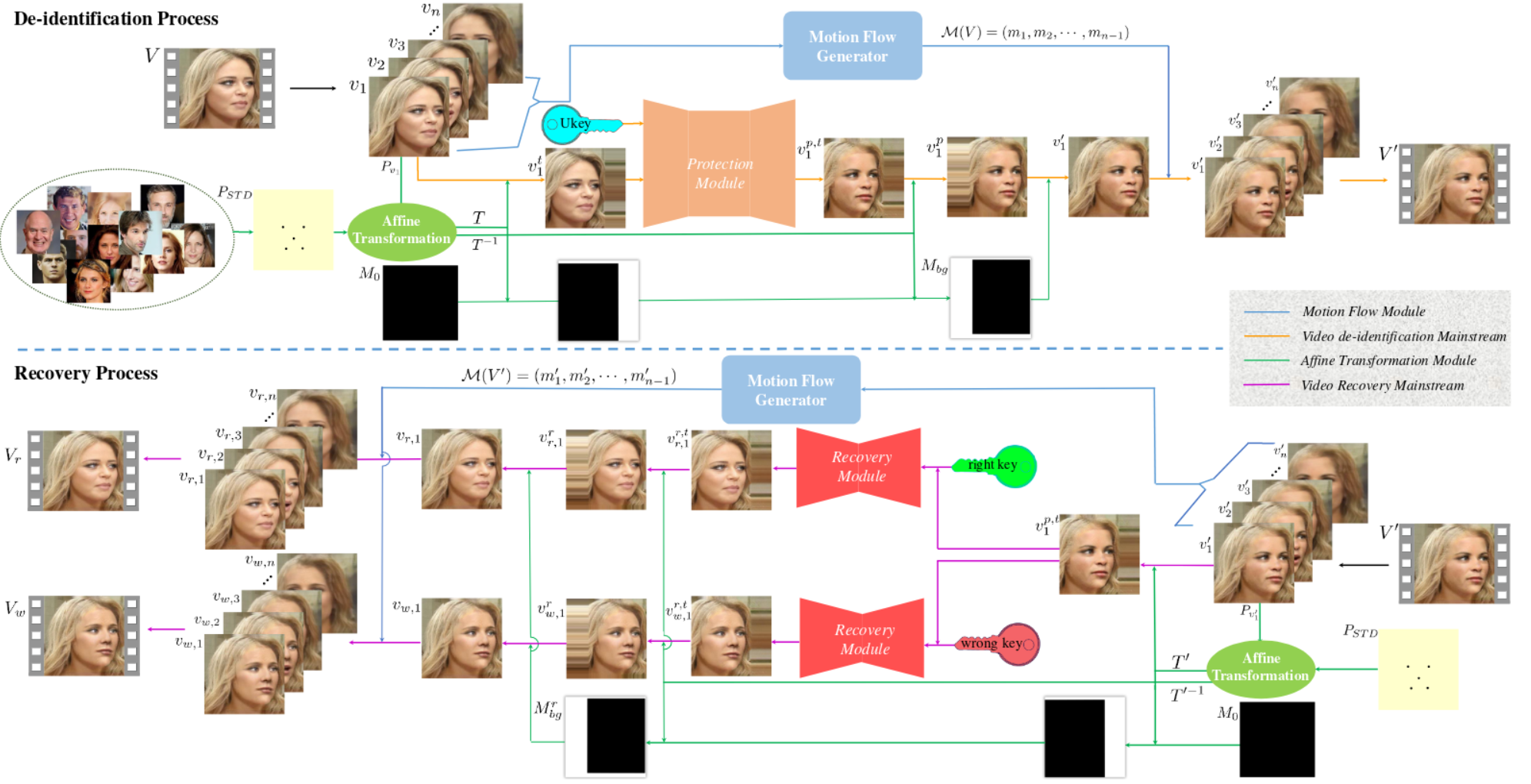

IdentityMask:

Deep Motion Flow Guided Reversible Face Video

De-identification

IdentityMask:深度运动流引导的可逆人脸视频匿名化

2022 Yuquan Wen等

针对问题

对于 可逆人脸匿名化:

需要混淆主体的敏感身份信息,同时尽量减少其他非身份特征(如外貌、姿势、表情、背景信息等)的 失真或变化,即 保证视觉相似性。

允许授权方完全还原匿名视频。

对于 视频匿名化:

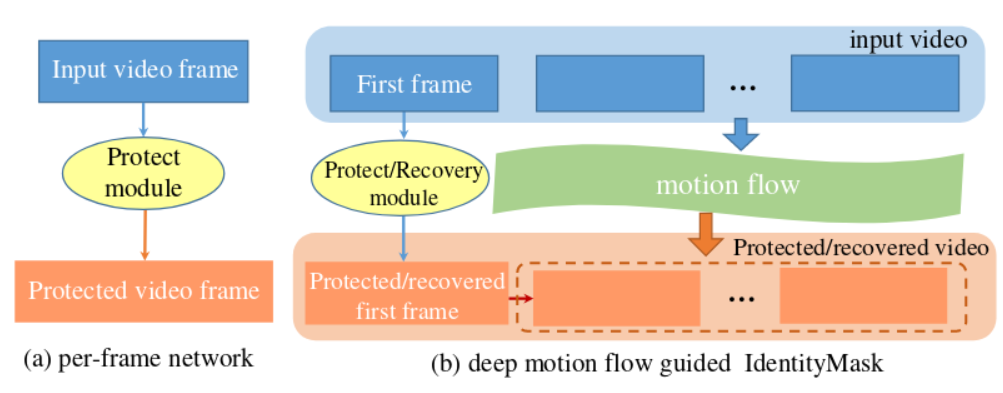

- 目前的方法不考虑 帧之间的时间关系,逐帧处理视频。

提出方法

IdentityMask的总体架构 如上图所示。

框架由两个过程组成:匿名化过程 为身份信息提供保护掩码;恢复过程 在且仅在提供正确的密钥时才移除保护掩码。前者依赖于 保护模块,后者依赖于 恢复模块,两者都由 运动流模块 引导,并由简单但可靠的 仿射变换模块 辅助。

保护模块

如上图所示,当给定一个原始的人脸帧时,我们应用 身份编码器 和 属性编码器 来提取潜在空间的两个分离表示。

基于此,我们首先使用 Ukey 作为随机种子生成一个参考身份向量

。 进而构造正交于

的分向量 。 通过可控参数

旋转 来创建新的身份 , 最后,我们通过训练好的融合网络

将 新的身份表示 和 原始属性表示 合成,得到匿名化的人脸。

恢复模块

给定匿名化后的人脸:

首先使用上述身份和属性编码器来提取其身份表示

和属性表示 给定正确的Ukey时,可以计算得到 恢复后的身份嵌入

. 最终通过上述网络

得到具有原始真实身份的正确恢复图像。

运动流模块

保护模块或恢复模块只处理第一帧,然后我们使用 运动流生成器 计算每两个相邻帧的相对运动流。

仿射变换模块

仿射变换用于规范第一帧的分布。

具体来说,我们计算 保护和恢复模块 训练数据集中 所有人脸的几个关键点,计算平均值并将其作为标准模式。

每次在第一帧输入到保护或恢复模块之前,首先以相同的方式计算其关键点。

然后将这些关键点 通过 仿射变换 与标准模式匹配。仿射变换是通过最小化两组点之间的失真获得的。使用这种仿射变换,我们将输入的第一帧人脸的每个像素扭曲到平均人脸的相应位置。

然后复制边缘颜色以将变形图像填充到与输入相同的维度。

结论

IdentityMask框架由 匿名化过程 和 恢复过程 组成。

匿名化过程 能够隐藏具有视觉相似外观的真实身份,而恢复过程 只有在获得正确的密钥时才能恢复原始身份。

利用运动流来指导连续帧的生成,减轻了计算开销,提高了合成效果。